什么是Robots.txt文件?如何创建一个Robots.txt文件

您是否知道自己可以完全控制搜索引擎等对您的wordpress网站进行爬取并将其索引?可控制访问wordpress网站的方法是通过Robots.txt的文件。

Robots.txt是一个简单的文本文件,位于网站的根目录中。它告诉“机器人”(例如搜索引擎蜘蛛)在您的网站上爬取哪些页面,忽略哪些页面。虽然Robots.txt文件不是必须的,但Robots.txt文件可让您对Google和其他搜索引擎如何查看您的网站进行控制。如果使用得当,可以改善wordpress网站的抓取效果甚至影响SEO。

但是,究竟如何创建有效的Robots.txt文件?创建后,如何使用它?并且在使用时应该避免什么错误?

什么是Robots.txt文件?

在互联网早期时代,程序员就创建了“机器人”或“蜘蛛”来对网页进行爬网和索引。有时,爬虫蜘蛛会进入网站所有者不希望被索引的页面(正在建设的网站或私人网站)。为了解决这个问题,早期的先驱者就标准达成了共识,这些标准被用作“机器人排除协议”(REP)。

Robots.txt文件是此协议的实现。REP定义了每个合法的爬虫或蜘蛛必须遵循的一组规则。如果Robots.txt指示漫游器不要为网页编制索引,则从Googlebot到MSNbot的每个合法搜索引擎都必须遵循。

但是,某些恶意机器人(例如恶意软件,间谍软件,电子邮件收集器等)可能不遵循这些协议。

您可以通过以下网址查看任何网站的robots.txt文件,https:// yourwebsite /robots.txt

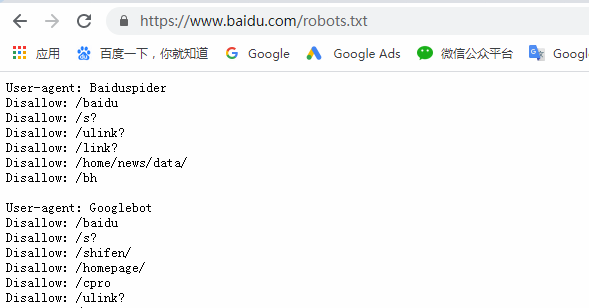

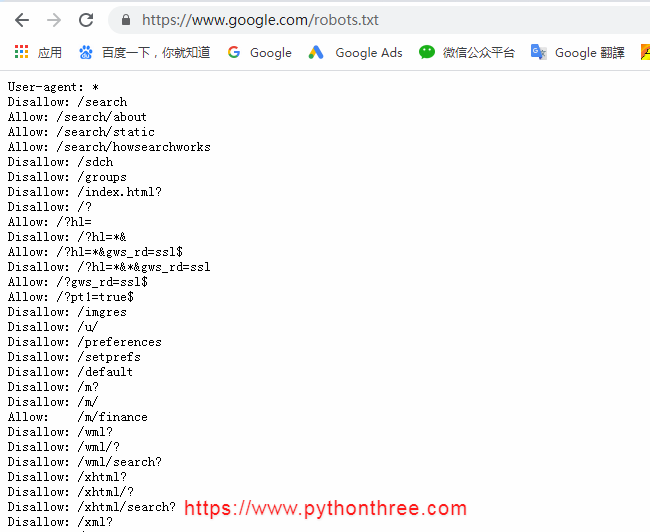

例如,这是Baidu的Robots.txt文件:

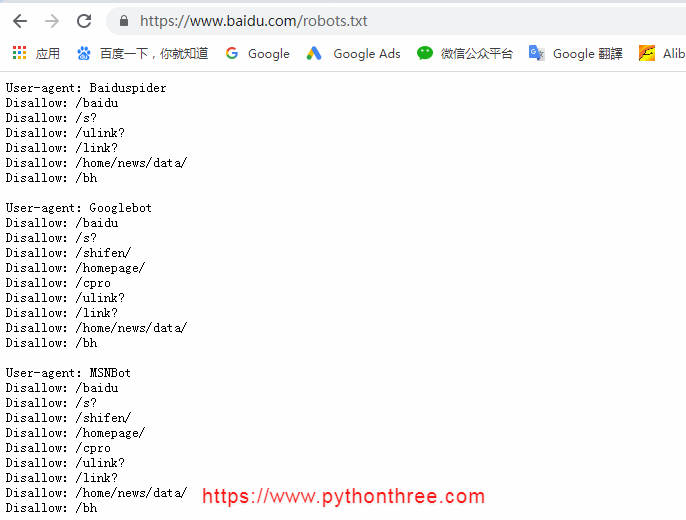

这是Google的Robots.txt文件:

使用Robots.txt文件的好处

Robots.txt并非网站的必要文档。没有此文件,您的网站可以排名并完美增长。但是,使用Robots.txt确实有一些好处:

阻止机器人爬网私有文件夹-尽管私人爬虫不遵守此规则,但对于合法的搜索引擎而已可以禁止机器人爬取私有文件夹,使它们更难索引。

控制资源的使用–每次爬虫爬网您的网站时,都会浪费带宽和服务器资源。这对内容多的网站会提高成本并给真实的访问者带来糟糕的体验。您可以使用Robots.txt阻止访问脚本,不重要的图像等,以节省资源。

对重要页面进行优先级排序–您希望搜索引擎蜘蛛抓取网站上的重要页面(例如内容页面),而不是浪费资源来浏览无用的页面。通过阻止此类无用的页面,您可以确定爬虫专注于哪些页面的优先级。

推荐:如何修复WordPress错误您的浏览器阻止或不支持Cookies

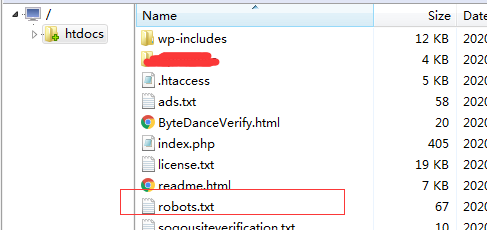

如何找到您的Robots.txt文件

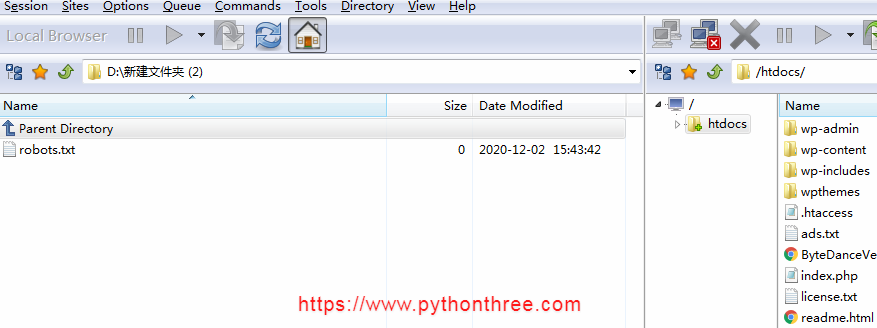

顾名思义,Robots.txt是一个简单的文本文件。存储在您网站的根目录中。要找到它,只需打开您的FTP工具并进入到htdocs下的网站目录。这是一个很小的文本文件,我的文件不超过100个字节。

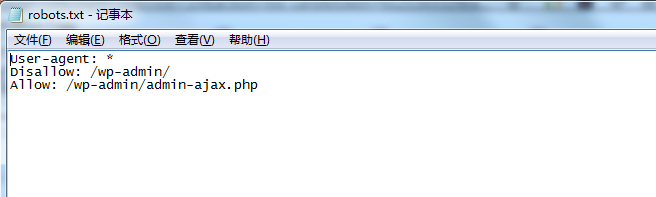

使用文本编辑器就能打开,例如记事本。您可能会看到以下内容:

推荐:FlyingPress插件教程WordPress轻量级速度优化插件

如何创建Robot.txt文件

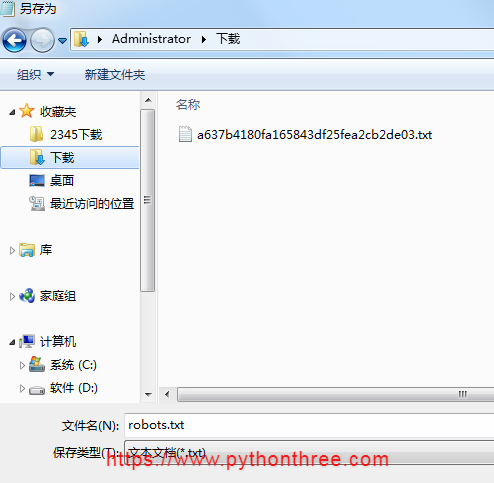

如果您在网站的根目录中看不到任何Robots.txt文件。在这种情况下,您必须自己创建一个Robots.txt文件。由于Robots.txt是基本的文本文件,因此创建它非常简单–只需打开文本编辑器,然后将一个空文件另存为robots.txt即可。就是这样:

要将此文件上传到服务器,请使用您喜欢的FTP工具(我建议使用WinSCP)登录到Web服务器。

打开网站的根目录后,只需将Robots.txt文件拖放到其中即可。

或者,您可以直接从FTP编辑器创建Robots.txt文件。

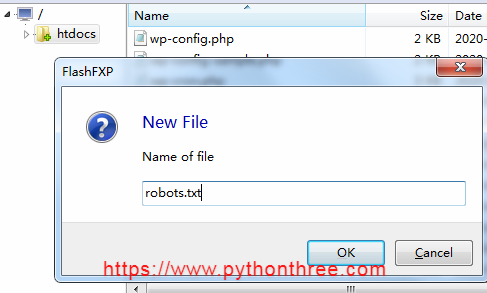

打开站点的根目录,然后右键单击->创建新文件。在对话框中,键入“ robots.txt”(不带引号),然后单击“确定”。

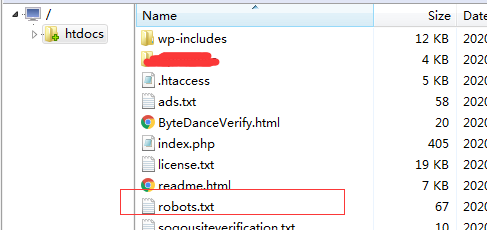

这样您可以看到一个新的robots.txt文件:

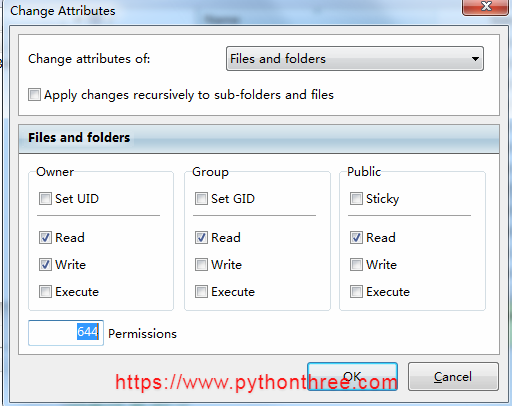

为了确保Robots.txt文件设置了正确的权限。只希望自己读取和写入文件,但不对其他人开放。所以,您的Robots.txt文件应显示“ 0644”作为权限代码。

如果没有,请右键单击您的Robots.txt文件,然后选择“文件权限”或者“Attributes”,设置权限后,保存即可。

推荐:WordPress优化修复WordPress网站速度慢加载慢

如何使用Robots.txt

Robots.txt文件本质上控制着搜索引擎爬虫机器人如何与您的网站进行交互。是否要阻止搜索引擎访问您的整个网站?只需在Robots.txt中更改权限。Robots.txt文件不会改善您的SEO,但可以使用它来控制网站上的抓取工具行为。要添加或修改文件,只需在FTP编辑器中将其打开并直接添加文本即可。

您可以在Robots.txt文件中使用以下命令:

1.阻止您网站中的所有爬虫机器人

要阻止所有的搜索引擎爬虫抓取您的网站?将此代码添加到您的Robots.txt文件中:

User-agent: * Disallow:/

此命令告诉搜索引擎爬虫代理(*)不要访问您站点上的任何文件或文件夹。

- User-agent: *,星号表示”通配符”用户代理,这意味着该说明适用于每个机器人,而不是任何特定机器人。

- Disallow:/,是robots.txt命令,不要访问该命令之后的网页或一组网页。

注意:请注意,这将阻止所有合法的爬虫机器人(例如Google)抓取您的网站。请谨慎使用。

2.阻止所有爬虫机器人访问特定文件夹

要防止爬虫抓取和索引特定文件夹怎么办?

使用此命令:

User-agent: * Disallow:/example-name/

如果要阻止爬虫访问抓取/ images文件夹,则命令如下所示:

User-agent: * Disallow:/images/

注意: / images文件夹纯粹是一个示例。

3.阻止您网站中的特定爬虫机器人

如果您想阻止特定的爬虫机器人(例如Googlebot)访问您的网站,该怎么办?

这是它的命令:

User-agent: Googlebot Disallow:/

每个合法的爬虫机器人都有一个特定的名称。例如,谷歌的蜘蛛简称为“ Googlebot”。微软同时运行“ msnbot”和“ bingbot”。要查找不同用户代理(例如Googlebot,bingbot等)的确切名称,请使用此页面。

注意:上面的命令将阻止站点中的特定的爬虫机器人。

4.阻止爬虫机器人过于频繁地爬行您的网站

此命令指示所有漫游器在爬网请求之间等待至少20秒。:

User-agent: *

Disallow:Crawl-delay: 20抓取延迟命令通常在内容频繁更新的大型网站上使用。此命令告诉爬虫机器人在后续请求之间等待最短的时间。这样可以确保服务器不会同时收到来自不同爬虫机器人的太多请求。

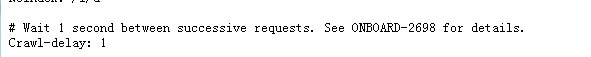

例如,这是Twitter的Robots.txt文件,指示爬虫机器人在两次请求之间等待至少1秒:

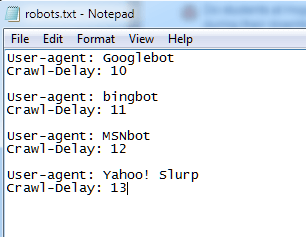

您甚至可以控制单个爬虫机器人的爬取延迟。这样可以确保过多的爬虫机器人不会同时抓取您的网站。

例如,您可能有一组这样的命令:

注意:除非您有一个每分钟创建成千上万个新页面(例如Twitter)的网站,否则您不需要使用此命令。

推荐:Perfmatters插件教程轻量WordPress性能优化插件

使用Robots.txt时应避免的常见错误

Robots.txt文件是用于控制您网站上机器人行为的强大工具。但是,如果使用不当,也可能导致SEO灾难。网上流传着许多关于Robots.txt的误解,这无济于事。

使用Robots.txt时,您必须避免以下错误:

错误1 –使用Robots.txt阻止内容被索引

如果您在Robots.txt文件中“禁止”文件夹,则合法的爬虫机器人将不会对其进行爬取。但是,这意味着:

- 爬虫机器人将抓取从外部源链接的文件夹的内容。

- 恶意僵尸程序-垃圾邮件,间谍软件,恶意软件等-通常会忽略Robots.txt指令并为您的内容建立索引。

可以使用替代方法:使用’meta noindex’标签。不想被索引的页面中添加以下标记,可阻止页面被索引,这是一种推荐的SEO友好方法,。

<meta name="robots" content =“ noindex”>

注意:如果您使用WordPress SEO插件,例如Yoast SEO或All in One SEO;您无需编辑任何代码即可执行此操作。

错误2 –使用Robots.txt阻止重复内容被索引

涉及到网站SEO时,重复的内容是个禁忌。使用Robots.txt阻止对此内容建立索引并不是解决方案;再次,不能保证搜索引擎蜘蛛不会通过外部资源找到此内容。

以下是三种处理重复内容的方法:

- 删除重复的内容:这意味着您正在将搜索引擎引导至404页,不建议删除。

- 使用301重定向:301重定向命令搜索引擎(和访客)网页已移动到新位置。只需在重复内容上添加301重定向,即可将访问者带到您的原始内容。

- 添加rel =“ canonical”标签–此标签是301重定向的“元”版本。“ rel = canonical”标签告诉Google特定页面的原始URL。例如,以下代码:

<link href =” https://www.pythonthree.com/what-is-robots-txt/ ” rel =” canonical” />

告诉Google该页面(original-page.html)是Google的“原始”版本重复页面。如果您使用WordPress,则可以使用Yoast SEO或All in One SEO轻松添加此标签。如果希望访问者能够访问重复的内容,请使用rel =“ canonical”标签。如果您不希望访问者或漫游器访问内容,请使用301重定向。

总结

以上是晓得博客为你介绍的什么是Robots.txt文件?如何创建一个Robots.txt文件的全部内容,Robots.txt文件是一个有用网站优化助手,可帮助控制搜索引擎蜘蛛和其他爬虫机器人与您的网站进行交互的方式。使用得当,可以对您的排名产生积极影响,并使您的网站更易于爬取。